在上一篇文章里,我分享了 Tidewave 和 Copilot 带来的不错体验。这个月趁着几天假期,我把实验又往前推了一步。这次的目标是测试编程辅助 AI 的两个极端:Claude Code 和本地模型 + OpenCode。前者成本高昂,被许多人视为当前编程 AI 的顶尖水平;而本地模型则意味着自由、隐私和更低的成本。

Claude Code Pro

Claude 最便宜的订阅是 Pro 版。我付了 20 美元/月,然后开始测试。我下载了桌面版、终端版,也试了与 Zed 和 Tidewave 的集成。终端体验很有趣,也很流畅。头几天我随手创建了一些项目,额度感觉还挺合理。Opus 4.6 的表现对于只用过免费或入门级模型的人来说确实惊艳。至少最开始,这种感觉是令人兴奋的。

我把结果给几个朋友看了,当时真的觉得每月 20 美元的 Claude 性价比很高——但这种感觉只维持了一周。每会话(大约 5 小时)和每周的额度被大幅削减,我很快就用超了。这次削减没有任何通知,连我这种刚订阅的用户也受到了影响。我的快乐非常短暂,真的太短暂了。现在的感受是:每月 20 美元不值。

Claude 测试的优点:

- 模型确实很强。Opus 和 Sonnet 是我用过最好的之一。

- 终端体验非常棒。

- 在额度被砍之前,价格是公道的。

- Skills 功能很好用。

- Skill 创建器帮我做出了很实用的 skills。

缺点:

- 桌面应用就是一坨垃圾。

- 移动端更差。

- 即使刚订阅的用户,额度也被砍了。对订阅者毫无尊重。

- 现在的额度让 Pro 订阅变成了一个纯演示版。不值。

那块 RTX 4090,意外变得有用起来

我是 2023 年 10 月买的 RTX 4090。年轻时一直梦想有一块顶级显卡,但当时没那个经济条件。买它的时候纯粹是为了打游戏。那时候本地 AI 模型还很原始,跑得慢,质量也远不如现在。没人会为了跑 LLM 而去买顶级显卡。到了 2026 年,情况完全不同了——这块卡现在被认为是消费级硬件里跑本地模型最好的选择之一。一个幸福的巧合。

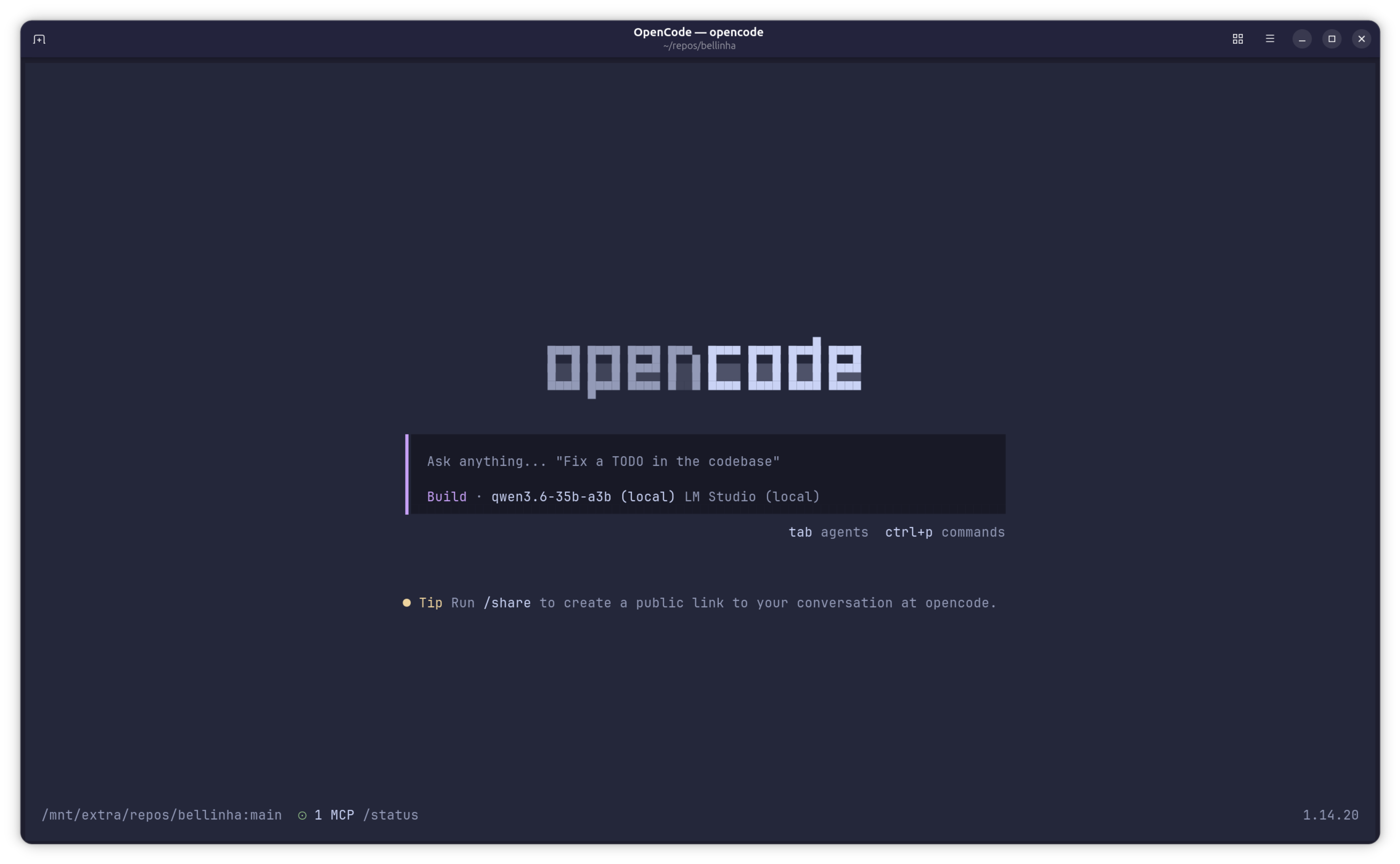

LM Studio + Qwen3.6 + OpenCode

我出门玩了几天,暂时远离电脑。旅行期间读到关于新版 Qwen 模型的消息,本地运行的效果让很多人印象深刻。这个模型是 Qwen3.6-35b-a3b,基准测试结果显示,它的性能与更高级的模型相当。它的某些变体可以完全跑在我这块 GPU 上,速度接近 100 tokens/秒。太棒了!

回来之后我没犹豫,直接装了 LM Studio,下载模型,开始测试。

LM Studio 本质上是一个运行 AI 模型的本地服务器。界面很简单:下载模型,启动服务器,就会在本地 URL 上提供服务。OpenCode 是客户端,一个连接到服务器并执行任务的 AI agent。

配置很简单。装好 LM Studio,搜索 Qwen3.6-35b-a3b 模型并下载。然后把 OpenCode 指向 LM Studio,搞定。

第一次用本地 Qwen 运行 OpenCode 的时候,体验……很熟悉。流程和 Claude Code 几乎一样:你给一个 prompt,agent 在终端里干活,修改文件、跑测试,不断迭代直到问题解决。区别在于一切都跑在我的本地机器上。

我快速做了一些测试,比如在现有项目里加几个小功能、重构几个函数、写一些测试。对我来说,我的用法很基础(AI 作为偶尔帮忙的助手,没有多 agent 也没有复杂的自动化),结果却让我印象深刻。模型能理解代码上下文,不需要太多额外努力就能正确完成修改。偶尔会出点错,但人工 review 一下就能解决。生成代码的质量出奇地好。

RTX 4090 的 24GB VRAM 跑这个模型毫无压力。响应速度足够快,不会打断工作流(很多时候比 Claude Code 还快),token 成本几乎可以忽略——基本就是电费。没有额度限制,也不用担心 token 烧得太快。

两个世界的对比

老实说,对我这种使用场景,我看不出本地 Qwen 和 Claude + Opus 之间有什么大区别。两者都能理解上下文,都能按需求完成任务,最终都需要人工复核。真正的差别绝对不在结果质量上。

用 Claude,你付了钱,但要受限于额度、网络、以及一家公司随时在月中更改规则的风险。用本地模型,硬件一次投入,想跑什么就跑什么,没有会话限制,模型自由选择。隐私是另一个显而易见的优势。

缺点呢?你需要好的硬件。RTX 4090 不便宜,个头也不小。 需要说明的是,对于和我不同的工作流,比如多个 agent 自主运行的情况,本地模型的效果可能就没这么好了。

结论

我暂时取消了 Claude 订阅。接下来一段时间会继续用本地模型,看看情况如何。到目前为止,体验很稳定。本地方案看起来解决了我需要的问题。

我不会说本地模型更好。各有各的适用场景。但如果你有合适的硬件,又不想被任意修改的额度和每月变动的订阅规则束缚,那么本地方案值得你考虑。

由人工智能翻译。我还在学习中文